เมตามี เปิดตัวคอลเล็กชั่น AI รุ่นใหม่llama 4, ในครอบครัว llama – ในวันเสาร์ไม่น้อย

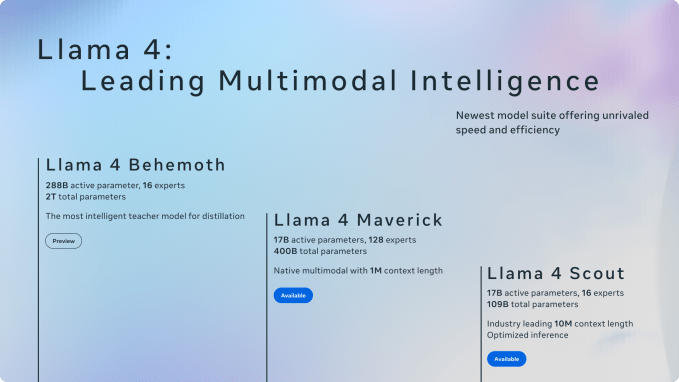

มีสี่รุ่นใหม่ทั้งหมด: Llama 4 Scout, Llama 4 Maverick และ Llama 4 Behemoth ทุกคนได้รับการฝึกฝนเกี่ยวกับ“ ข้อมูลภาพและวิดีโอที่ไม่มีป้ายกำกับจำนวนมาก” เพื่อให้พวกเขา“ เข้าใจภาพในวงกว้าง” Meta กล่าว

ความสำเร็จของโมเดลแบบเปิดจาก Lab จีน ลึกล้ำซึ่งทำงานในราคาที่ดีกว่าหรือดีกว่ารุ่น Llama เรือธงก่อนหน้าของ Meta รายงานว่ามีการพัฒนาการพัฒนา Llama เป็น Overdrive Meta ได้รับการกล่าวขานว่ามีห้องสงครามที่มีสัญญาณรบกวนเพื่อถอดรหัสว่า Deepseek ลดค่าใช้จ่ายในการวิ่งและปรับใช้แบบจำลองอย่างไร R1 และ V3–

Scout และ Maverick เปิดให้บริการอย่างเปิดเผย llama.com และจากพันธมิตรของ Meta รวมถึงแพลตฟอร์ม AI Dev Hugging Face ในขณะที่ Behemoth ยังอยู่ในการฝึกอบรม Meta กล่าวว่า Meta AI ซึ่งเป็นผู้ช่วย AI ที่ขับเคลื่อนด้วยแอพรวมถึง WhatsApp, Messenger และ Instagram ได้รับการปรับปรุงให้ใช้ Llama 4 ใน 40 ประเทศ ฟีเจอร์หลายรูปแบบ จำกัด เฉพาะสหรัฐอเมริกาเป็นภาษาอังกฤษในตอนนี้

นักพัฒนาบางคนอาจมีปัญหากับใบอนุญาต Llama 4

ผู้ใช้และ บริษัท “ ภูมิลำเนา” หรือ“ สถานที่สำคัญของธุรกิจ” ในสหภาพยุโรปคือ ห้ามใช้หรือแจกจ่ายแบบจำลองน่าจะเป็นผลมาจากข้อกำหนดการกำกับดูแลที่กำหนดโดย AI และกฎหมายความเป็นส่วนตัวของข้อมูลในภูมิภาค (ในอดีตเมตามี ประณามกฎหมายเหล่านี้ นอกจากนี้เช่นเดียวกับการเปิดตัว Llama ก่อนหน้านี้ บริษัท ที่มีผู้ใช้งานมากกว่า 700 ล้านคนต่อเดือนจะต้องขอใบอนุญาตพิเศษจาก Meta ซึ่ง Meta สามารถให้หรือปฏิเสธดุลยพินิจของตนได้ แต่เพียงผู้เดียว

“ รุ่น Llama 4 เหล่านี้เป็นจุดเริ่มต้นของยุคใหม่สำหรับระบบนิเวศ Llama” Meta เขียนในบล็อกโพสต์– “ นี่เป็นเพียงจุดเริ่มต้นสำหรับคอลเล็กชั่น Llama 4”

Meta กล่าวว่า Llama 4 เป็นรุ่นแรกของรุ่นที่ใช้ส่วนผสมของสถาปัตยกรรมผู้เชี่ยวชาญ (MOE) ซึ่งมีประสิทธิภาพในการคำนวณมากขึ้นสำหรับการฝึกอบรมและการตอบคำถาม สถาปัตยกรรม MOE โดยทั่วไปจะแบ่งงานประมวลผลข้อมูลออกเป็นงานย่อยแล้วมอบหมายให้กับโมเดล“ ผู้เชี่ยวชาญ” ขนาดเล็กที่มีขนาดเล็กลง

ตัวอย่างเช่น Maverick มีพารามิเตอร์ทั้งหมด 400 พันล้านตัว แต่มีเพียง 17 พันล้าน คล่องแคล่ว พารามิเตอร์ใน 128“ ผู้เชี่ยวชาญ” (พารามิเตอร์ประมาณสอดคล้องกับทักษะการแก้ปัญหาของโมเดล) Scout มีพารามิเตอร์ที่ใช้งานอยู่ 17 พันล้านคนผู้เชี่ยวชาญ 16 คนและพารามิเตอร์ทั้งหมด 109 พันล้านพารามิเตอร์

จากการทดสอบภายในของ Meta Maverick ซึ่ง บริษัท บอกว่าดีที่สุดสำหรับกรณีการใช้ “ผู้ช่วยทั่วไปและแชท” เช่นการเขียนเชิงสร้างสรรค์เกินกว่ารุ่นต่าง ๆ เช่น Openai’s GPT-4O และ Google’s ราศีเมถุน 2.0 ในการเข้ารหัสการใช้เหตุผลการพูดได้หลายภาษาบริบทและเกณฑ์มาตรฐานภาพ อย่างไรก็ตามผู้ไม่ฝักใฝ่ฝ่ายใดไม่ได้วัดรุ่นล่าสุดที่มีความสามารถมากขึ้นเช่น Google’s ราศีเมถุน 2.5 โปรมานุษยวิทยา Claude 3.7 Sonnetและ Openai’s GPT-4.5–

จุดแข็งของลูกเสืออยู่ในงานเช่นการสรุปเอกสารและการให้เหตุผลกับรหัสฐานขนาดใหญ่ มันมีหน้าต่างบริบทที่มีขนาดใหญ่มาก: 10 ล้านโทเค็น (“ โทเค็น” แสดงถึงบิตของข้อความดิบ – เช่นคำว่า “มหัศจรรย์” แบ่งออกเป็น “แฟน” “tas” และ “tic”) ในภาษาอังกฤษธรรมดาลูกเสือสามารถถ่ายภาพและมากถึงหลายล้านคำทำให้สามารถประมวลผลและทำงานกับเอกสารที่มีความยาวมาก

ลูกเสือสามารถทำงานบน Nvidia H100 GPU เดียวในขณะที่ Maverick ต้องการระบบ Nvidia H100 DGX หรือเทียบเท่าตามการคำนวณของ Meta

Behemoth ที่ยังไม่ได้เผยแพร่ของ Meta จะต้องใช้ฮาร์ดแวร์ที่ดีกว่า จากข้อมูลของ บริษัท Behemoth มีพารามิเตอร์ที่ใช้งานอยู่ 288 พันล้านคนผู้เชี่ยวชาญ 16 คนและพารามิเตอร์ทั้งหมดเกือบสองล้านล้านพารามิเตอร์ การเปรียบเทียบภายในของ Meta นั้นมีประสิทธิภาพสูงกว่า GPT-4.5, Claude 3.7 Sonnet และ Gemini 2.0 Professional (แต่ไม่ใช่ 2.5 Professional) ในการประเมินหลายอย่างที่วัดทักษะต้นกำเนิดเช่นการแก้ปัญหาทางคณิตศาสตร์

สิ่งที่ควรทราบไม่มีโมเดล Llama 4 เป็นโมเดล“ การใช้เหตุผล” ที่เหมาะสมตามแนวของ Openai’s O1 และ O3-mini– การให้เหตุผลแบบจำลองข้อเท็จจริงตรวจสอบคำตอบของพวกเขาและโดยทั่วไปตอบคำถามที่น่าเชื่อถือมากขึ้น แต่ดังนั้นจึงใช้เวลานานกว่าแบบจำลองแบบดั้งเดิมที่“ ไม่มีเหตุผล” เพื่อส่งคำตอบ

ที่น่าสนใจ Meta กล่าวว่ามันปรับโมเดล Llama 4 ทั้งหมดของมันเพื่อปฏิเสธที่จะตอบคำถามที่“ ถกเถียง” น้อยลงบ่อยครั้ง ตามที่ บริษัท Llama 4 ตอบสนองต่อหัวข้อทางการเมืองและสังคมที่ถกเถียงกัน” ที่รุ่นก่อนหน้าของนางแบบ Llama จะไม่ นอกจากนี้ บริษัท ยังกล่าวอีกว่า Llama 4 นั้น“ สมดุลมากขึ้นอย่างมาก” ซึ่งทำให้มันไม่ได้รับความบันเทิง

“ (y) ou สามารถไว้วางใจ (lllama 4) เพื่อให้การตอบสนองที่เป็นประโยชน์และเป็นประโยชน์โดยไม่มีการตัดสิน” โฆษกเมตากล่าวกับ TechCrunch “ (w) กำลังดำเนินการต่อไปเพื่อให้ลามาตอบสนองต่อการตอบคำถามเพิ่มเติมสามารถตอบสนองต่อมุมมองที่แตกต่างที่หลากหลาย (…) และไม่ชอบมุมมองของผู้อื่น”

การปรับแต่งเหล่านั้นมาเป็นพันธมิตรทำเนียบขาวกล่าวหาว่า AI chatbots เป็น“ ตื่น” ทางการเมืองมากเกินไป

ประธานาธิบดีโดนัลด์ทรัมป์หลายคนซึ่งเป็นคนสนิทของประธานาธิบดีโดนัลด์ทรัมป์รวมถึงมหาเศรษฐี Elon Musk และ Crypto และ AI“ Czar” David Sacks ได้กล่าวหาว่า AI chatbots ยอดนิยม เซ็นเซอร์มุมมองอนุรักษ์นิยม– กระสอบมีประวัติศาสตร์ แยกออก CHATGPT ของ Openai เป็น“ โปรแกรมให้ตื่น” และไม่จริงเกี่ยวกับเรื่องการเมือง

ในความเป็นจริงอคติใน AI เป็นปัญหาทางเทคนิคที่ดื้อรั้น Xai บริษัท AI ของ Musk มี ดิ้นรน เพื่อสร้าง chatbot ที่ไม่รับรองมุมมองทางการเมืองบางอย่างกับผู้อื่น

ที่ไม่ได้หยุด บริษัท รวมถึง Openai จาก การปรับ แบบจำลอง AI ของพวกเขาเพื่อตอบคำถามมากกว่าที่เคยมีมาก่อนหน้านี้ในคำถามเฉพาะที่เกี่ยวข้องกับวิชาที่ถกเถียงกัน

(tagstotranslate) llama 4