กระดาษใหม่ จาก AI Lab Cohere, Stanford, MIT และ AI2 กล่าวหาว่า LM Enviornment ซึ่งเป็นองค์กรที่อยู่เบื้องหลัง Crowdsourced AI Benchmark Chatbot Enviornment ที่ได้รับความนิยมในการช่วยเหลือกลุ่ม บริษัท AI ที่ได้รับการคัดเลือกให้ได้คะแนนลีดเดอร์บอร์ดที่ดีขึ้นด้วยค่าใช้จ่ายของคู่แข่ง

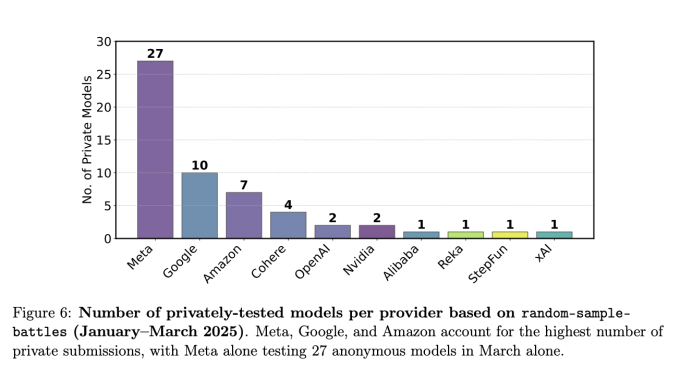

ตามที่ผู้เขียน LM Enviornment อนุญาตให้ บริษัท AI ชั้นนำในอุตสาหกรรมบางแห่งเช่น Meta, Openai, Google และ Amazon เพื่อทดสอบแบบเอกชนหลายรุ่นของโมเดล AI จากนั้นไม่เผยแพร่คะแนนของนักแสดงต่ำสุด สิ่งนี้ทำให้ง่ายขึ้นสำหรับ บริษัท เหล่านี้ที่จะได้รับตำแหน่งสูงสุดในกระดานผู้นำของแพลตฟอร์มแม้ว่าโอกาสจะไม่ได้รับการจ่ายให้กับทุก บริษัท แต่ผู้เขียนกล่าว

“ มีเพียงไม่กี่ บริษัท เท่านั้นที่ได้รับการบอกกล่าวว่าการทดสอบส่วนตัวนี้มีอยู่และจำนวนการทดสอบส่วนตัวที่บาง บริษัท ที่ได้รับนั้นได้รับมากกว่า บริษัท อื่น ๆ ” รองประธานฝ่ายวิจัย AI ของ Cohere กล่าวและผู้เขียนร่วมของการศึกษา Sara Hooker กล่าว “ นี่คือ gamification”

สร้างขึ้นในปี 2566 ในฐานะโครงการวิจัยเชิงวิชาการจาก UC Berkeley, Chatbot Enviornment ได้กลายเป็นเกณฑ์มาตรฐานสำหรับ บริษัท AI มันใช้งานได้โดยการใส่คำตอบจากสองรุ่น AI ที่แตกต่างกันเคียงข้างกันใน“ การต่อสู้” และขอให้ผู้ใช้เลือกสิ่งที่ดีที่สุด ไม่ใช่เรื่องแปลกที่จะเห็นโมเดลที่ยังไม่เผยแพร่ในเวทีภายใต้นามแฝง

คะแนนเสียงเมื่อเวลาผ่านไปมีส่วนช่วยให้คะแนนของนางแบบ – และดังนั้นการจัดวางบนกระดานผู้นำ Chatbot Enviornment ในขณะที่นักแสดงเชิงพาณิชย์หลายคนมีส่วนร่วมใน Chatbot Enviornment, LM Enviornment ได้ยืนยันมานานแล้วว่ามาตรฐานของมันเป็นสิ่งที่เป็นกลางและยุติธรรม

อย่างไรก็ตามนั่นไม่ใช่สิ่งที่ผู้เขียนกระดาษบอกว่าพวกเขาค้นพบ

บริษัท AI หนึ่งแห่งคือ Meta สามารถทดสอบแบบจำลองรุ่น 27 รุ่นบน Chatbot Enviornment ระหว่างเดือนมกราคมถึงเดือนมีนาคมที่นำไปสู่การเปิดตัว Llama 4 ของยักษ์ใหญ่ด้านเทคโนโลยีผู้เขียนกล่าวหา ในการเปิดตัวเมตาเพียงเปิดเผยคะแนนของรุ่นเดียว – โมเดลที่เกิดขึ้นในอันดับใกล้กับจุดสูงสุดของ Chatbot Enviornment Board

กิจกรรม TechCrunch

Berkeley, CA

–

5 มิถุนายน

ในอีเมลถึง TechCrunch ผู้ร่วมก่อตั้ง LM Enviornment และศาสตราจารย์ Ion Stoica ของ UC Berkeley กล่าวว่าการศึกษาเต็มไปด้วย“ ความไม่ถูกต้อง” และ“ การวิเคราะห์ที่น่าสงสัย”

“ เรามุ่งมั่นที่จะประเมินความเป็นธรรมที่ขับเคลื่อนด้วยชุมชนและเชิญผู้ให้บริการโมเดลทั้งหมดให้ส่งแบบจำลองเพิ่มเติมสำหรับการทดสอบและปรับปรุงประสิทธิภาพการทำงานของพวกเขาในการตั้งค่าของมนุษย์” LM Enviornment กล่าวในแถลงการณ์ที่ให้กับ TechCrunch “ หากผู้ให้บริการรุ่นเลือกที่จะส่งการทดสอบมากกว่าผู้ให้บริการรุ่นอื่นนี่ไม่ได้หมายความว่าผู้ให้บริการรุ่นที่สองจะได้รับการปฏิบัติอย่างไม่เป็นธรรม”

Armand Joulin นักวิจัยหลักของ Google Deepmind ได้กล่าวไว้ในก โพสต์บน x ว่าตัวเลขการศึกษาบางอย่างไม่ถูกต้องโดยอ้างว่า Google ส่งเพียงหนึ่งรุ่น Gemma 3 AI ไปยัง LM Enviornment สำหรับการทดสอบก่อนวางจำหน่าย Hooker ตอบกลับ Joulin บน X สัญญาว่าผู้เขียนจะทำการแก้ไข

ห้องปฏิบัติการที่ชื่นชอบ

ผู้เขียนกระดาษเริ่มทำการวิจัยในเดือนพฤศจิกายน 2567 หลังจากเรียนรู้ว่า บริษัท AI บางแห่งอาจได้รับสิทธิพิเศษในการเข้าถึง Chatbot Enviornment โดยรวมแล้วพวกเขาวัดการต่อสู้กับ Chatbot Enviornment มากกว่า 2.8 ล้านครั้งในระยะเวลาห้าเดือน

ผู้เขียนกล่าวว่าพวกเขาพบหลักฐานว่า LM Enviornment อนุญาตให้ บริษัท AI บางแห่งรวมถึง Meta, Openai และ Google เพื่อรวบรวมข้อมูลเพิ่มเติมจาก Chatbot Enviornment โดยให้แบบจำลองของพวกเขาปรากฏในจำนวน “การต่อสู้” ที่สูงขึ้น อัตราการสุ่มตัวอย่างที่เพิ่มขึ้นนี้ทำให้ บริษัท เหล่านี้ได้เปรียบอย่างไม่เป็นธรรมผู้เขียนกล่าวหา

การใช้ข้อมูลเพิ่มเติมจาก LM Enviornment สามารถปรับปรุงประสิทธิภาพของโมเดลบน Enviornment Onerous ได้อีกหนึ่งเกณฑ์มาตรฐาน LM Enviornment รักษาได้ 112% อย่างไรก็ตาม LM Enviornment กล่าวในก โพสต์บน x ประสิทธิภาพที่ยากลำบากนั้นไม่สัมพันธ์โดยตรงกับประสิทธิภาพของ Chatbot Enviornment

Hooker กล่าวว่ายังไม่มีความชัดเจนว่า บริษัท AI บาง บริษัท อาจได้รับการเข้าถึงลำดับความสำคัญอย่างไร แต่มันเป็นหน้าที่ของ LM Enviornment เพื่อเพิ่มความโปร่งใสโดยไม่คำนึงถึง

ใน โพสต์บน xLM Enviornment กล่าวว่าการเรียกร้องหลายครั้งในกระดาษไม่ได้สะท้อนความเป็นจริง องค์กรชี้ไปที่ก โพสต์บล็อก มันตีพิมพ์เมื่อต้นสัปดาห์ที่ผ่านมาแสดงให้เห็นว่าแบบจำลองจากห้องปฏิบัติการที่ไม่ใช่ Main ปรากฏในการต่อสู้ของ Chatbot Enviornment มากกว่าการศึกษาที่แนะนำ

ข้อ จำกัด ที่สำคัญอย่างหนึ่งของการศึกษาคือมันขึ้นอยู่กับ“ การระบุตัวตน” เพื่อพิจารณาว่าโมเดล AI ใดในการทดสอบส่วนตัวเกี่ยวกับ Chatbot Enviornment ผู้เขียนแจ้งให้แบบจำลอง AI หลายครั้งเกี่ยวกับ บริษัท ต้นกำเนิดของพวกเขาและอาศัยคำตอบของโมเดลในการจำแนกพวกเขา – วิธีการที่ไม่สามารถเข้าใจได้

อย่างไรก็ตาม Hooker กล่าวว่าเมื่อผู้เขียนเอื้อมมือไปที่ LM Enviornment เพื่อแบ่งปันผลการวิจัยเบื้องต้นของพวกเขาองค์กรไม่ได้โต้แย้งพวกเขา

TechCrunch เอื้อมมือไปที่ Meta, Google, Openai และ Amazon ซึ่งทั้งหมดนี้ถูกกล่าวถึงในการศึกษา – เพื่อแสดงความคิดเห็น ไม่มีใครตอบกลับทันที

LM Enviornment ในน้ำร้อน

ในกระดาษผู้เขียนเรียกร้องให้ LM Enviornment ใช้การเปลี่ยนแปลงจำนวนมากที่มีวัตถุประสงค์เพื่อทำให้ Chatbot Enviornment มากขึ้น“ ยุติธรรม” ตัวอย่างเช่นผู้เขียนกล่าวว่า LM Enviornment สามารถกำหนดขีด จำกัด ที่ชัดเจนและโปร่งใสเกี่ยวกับจำนวนการทดสอบส่วนตัว AI Labs สามารถดำเนินการและเปิดเผยคะแนนจากสาธารณชนจากการทดสอบเหล่านี้

ใน โพสต์บน x, LM Enviornment ปฏิเสธคำแนะนำเหล่านี้โดยอ้างว่าได้เผยแพร่ข้อมูลเกี่ยวกับการทดสอบก่อนการเปิดตัว ตั้งแต่เดือนมีนาคม 2567– องค์กรการเปรียบเทียบยังกล่าวอีกว่า“ ไม่มีเหตุผลที่จะแสดงคะแนนสำหรับโมเดลก่อนการเปิดตัวซึ่งไม่เปิดเผยต่อสาธารณะ” เพราะชุมชน AI ไม่สามารถทดสอบแบบจำลองด้วยตนเองได้

นักวิจัยยังกล่าวอีกว่า LM Enviornment สามารถปรับอัตราการสุ่มตัวอย่างของ Chatbot Enviornment เพื่อให้แน่ใจว่าทุกรุ่นในเวทีปรากฏในการต่อสู้จำนวนเท่ากัน LM Enviornment เปิดกว้างต่อคำแนะนำนี้ต่อสาธารณะและระบุว่ามันจะสร้างอัลกอริทึมการสุ่มตัวอย่างใหม่

กระดาษมาหลายสัปดาห์หลังจากเมตาถูกจับเกณฑ์มาตรฐานการเล่นเกมใน Chatbot Enviornment รอบ ๆ การเปิดตัวรุ่น Llama 4 ที่กล่าวถึงข้างต้น Meta เพิ่มประสิทธิภาพหนึ่งในรุ่น Llama 4 สำหรับ“ การสนทนา” ซึ่งช่วยให้ได้คะแนนที่น่าประทับใจบนกระดานผู้นำของ Chatbot Enviornment แต่ บริษัท ไม่เคยเปิดตัวโมเดลที่ได้รับการปรับปรุง – และรุ่นวานิลลา จบลงด้วยการแสดงแย่ลงมาก บน Chatbot Enviornment

ในเวลานั้น LM Enviornment กล่าวว่าเมตาควรมีความโปร่งใสมากขึ้นในการเปรียบเทียบการเปรียบเทียบ

เมื่อต้นเดือนนี้ LM Enviornment ประกาศว่าเป็น เปิดตัว บริษัทด้วยแผนการระดมทุนจากนักลงทุน การศึกษาเพิ่มการตรวจสอบข้อเท็จจริงเกี่ยวกับองค์กรมาตรฐานเอกชน – และไม่ว่าพวกเขาจะได้รับความไว้วางใจในการประเมินแบบจำลอง AI โดยไม่มีอิทธิพลขององค์กรที่ทำให้กระบวนการขุ่นมัวหรือไม่

(tagstotranslate) มาตรฐาน AI